Вы плохо танцуете, но вы хотите показать друзьям, какой вы профессиональный танцор? Теперь можно подделать танец с помощью искусственного интеллекта.

Ученые из Калифорнийского университета в Беркли разработали программное обеспечение для машинного обучения, в котором используются генеративно-состязательные сети (GAN), которые могут копировать движения профессиональных исполнителей и переносить их на лицо и тело любого человека. Таким образом, вы можете заставить любого человека исполнять удивительные пируэты на видео, даже если он не умеет или не хочет танцевать вообще.

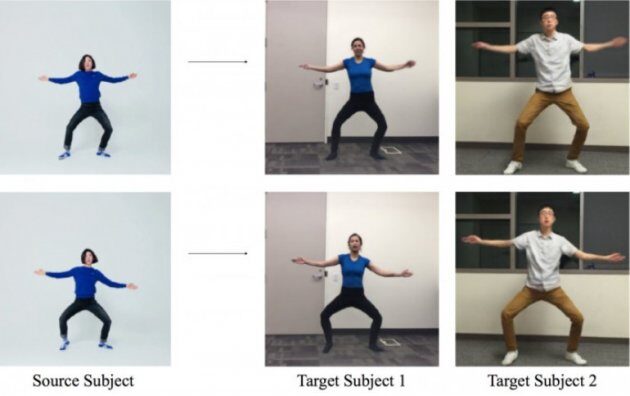

«Учитывая, что мы имеем видео человека-источника и человека-цели, наша задача состоит в том, чтобы создать новое видео последнего, исполняющего те же самые движения, что и источник», - пишут исследователи в своей статье.

Ниже видео, просмотрев которое вы можете сами убедиться в реалистичности движений:

До того, как танец будет перенесен из опытного источника на неуклюжую цель, существует промежуточная стадия. Исследователи используют обученную нейронную сеть для преобразования поз и движений исходного тела в анимированные фигуры, соответствующие этим движениям. Этот шаг требуется, потому что невозможно выполнить прямое взаимно однозначное сопоставление от источника к цели. Вместо этого проще упростить исходное тело в линиях, а затем использовать их, чтобы манипулировать телом цели. Затем ИИ начнет вмешиваться во внешний вид цели, чтобы заставить ее двигаться, как простая линейная фигура, получившая движения профессионального танцора.

Эти изображения затем объединяются в видео, которое убеждает всех, что цель – хороший танцор. Существует также отдельная система обучения, которая изучает мимику. Ведь если лицо размыто, то и все тело выглядит неправдоподобным. В этом случае исследователи используют другой GAN.

Результаты очень хороши для первой попытки, но не идеальны. Иногда небольшие детали, такие как руки или ноги, могут быть немного размытыми. Наблюдательный зритель сможет понять, что в видео есть что-то искусственное.

Существуют опасения, что данной технологией могут злоупотреблять, чтобы создавать поддельные видео или изображения, которые обманывают других людей.

Можно представить, что людей могут подставить, показав, как они совершают противозаконные действия. Пока разработчики не сообщают, что они могут предложить в данном случае.

Ученые из Калифорнийского университета в Беркли разработали программное обеспечение для машинного обучения, в котором используются генеративно-состязательные сети (GAN), которые могут копировать движения профессиональных исполнителей и переносить их на лицо и тело любого человека. Таким образом, вы можете заставить любого человека исполнять удивительные пируэты на видео, даже если он не умеет или не хочет танцевать вообще.

«Учитывая, что мы имеем видео человека-источника и человека-цели, наша задача состоит в том, чтобы создать новое видео последнего, исполняющего те же самые движения, что и источник», - пишут исследователи в своей статье.

Ниже видео, просмотрев которое вы можете сами убедиться в реалистичности движений:

До того, как танец будет перенесен из опытного источника на неуклюжую цель, существует промежуточная стадия. Исследователи используют обученную нейронную сеть для преобразования поз и движений исходного тела в анимированные фигуры, соответствующие этим движениям. Этот шаг требуется, потому что невозможно выполнить прямое взаимно однозначное сопоставление от источника к цели. Вместо этого проще упростить исходное тело в линиях, а затем использовать их, чтобы манипулировать телом цели. Затем ИИ начнет вмешиваться во внешний вид цели, чтобы заставить ее двигаться, как простая линейная фигура, получившая движения профессионального танцора.

Эти изображения затем объединяются в видео, которое убеждает всех, что цель – хороший танцор. Существует также отдельная система обучения, которая изучает мимику. Ведь если лицо размыто, то и все тело выглядит неправдоподобным. В этом случае исследователи используют другой GAN.

Результаты очень хороши для первой попытки, но не идеальны. Иногда небольшие детали, такие как руки или ноги, могут быть немного размытыми. Наблюдательный зритель сможет понять, что в видео есть что-то искусственное.

Существуют опасения, что данной технологией могут злоупотреблять, чтобы создавать поддельные видео или изображения, которые обманывают других людей.

Можно представить, что людей могут подставить, показав, как они совершают противозаконные действия. Пока разработчики не сообщают, что они могут предложить в данном случае.